研究室概要

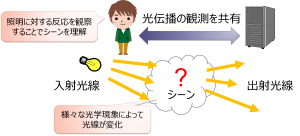

2014年2月に向川教授が着任し,新たに「光メディアインタフェース研究室」をスタートさせました.この研究室では,カメラで撮影された情報をもとにシーンを理解するコンピュータビジョンの中でも,特に光学解析を中心に取り扱っています.光源から出た光は,シーン中で反射・屈折・散乱等の光学現象を繰り返し, カメラや我々の眼に届きます. 我々人間は眼で見ただけで, 物体表面の状態がツルツルしているのかザラザラしているのかといった表面の荒さだけではなく, 重いのか軽いのかといった質量や, 金属なのかプラスチックなのかといった材質に関する物理情報, さらには安っぽいのか高級感があるのかといった感性に関わる情報も感じ取っています. つまり,光線はシーンに関する貴重な情報を運ぶ媒体と考えることができます. 光線の伝播を解析する基礎研究を土台に,人間と機械が光を媒体としてシーンに関する情報を共有できる新しいインタフェースの実現を目指しています.

2014年4月には博士前期課程の学生5名がメンバに加わり,また6月には久保助教が着任し,和気あいあい一丸となって研究室を立ちあげてきました.まだまだ小さい研究室ですが,大阪大学,九州大学,早稲田大学,広島大学などとも一緒に共同で研究を進めています.また,いくつかの企業とも共同研究が始まりました.

立ち上げ直後の研究室のため,アドバイスをくれる先輩たちが居ない中でも,第1期の学生たちが協同でCICP2014 (Creative and International Competitiveness Project) のプロジェクト「写ラナインです(余計なモノが)」を進めました.その成果を電気関係学会関西連合大会で発表し,映像情報メディア学会関西支部優秀論文発表賞をいただきました.また,先日のCICP成果報告会でも最優秀賞をいただきました.今回はそのプロジェクトの内容についてご紹介します.

プロジェクト紹介:「写ラナインです(余計なモノが)」

ほとんどの方が観光やスポーツ観戦に出かけると,その思い出を写真として記録するのではないでしょうか.最近では,スマートフォンやPCで,写真の加工やSNSへの共有を行うなど,楽しみ方が新たに広がっています.写真を撮るという行為は,もはや文化として根付いていると言ってよいでしょう.さて,この写真撮影ですが,せっかくの良いシーンだったのに,ピンぼけや映り込みなどによって失敗してしまい,写真が台無しになってしまった,なんてことはないでしょうか.今回私たちは,そんな失敗を解決するようなシステム,その名も「写ラナインです(余計なモノが)」を開発しました.

ディジタルカメラで撮影された画像というのは,いわゆる2次元のデータとして記録されますが,撮影対象となるシーンは,もちろん2次元ではありません.次元が落ちているということはすなわち,画像データになった時点で,多くの情報が欠落したデータになってしまいます.そこで,我々のシステムでは,カメラを平面上で移動させることによって,シーンを2次元の画像データとしてではなく,4次元光線空間と呼ばれるデータとして,シーン中の「光線の」情報を記録します.画像よりもリッチな光線空間を取得することによって,通常のカメラでは不可能な,新たなイメージングが可能となります.以下で私たちのシステムが可能とした,新たなイメージングについてご紹介します.

画素ごとにフォーカス合わせ

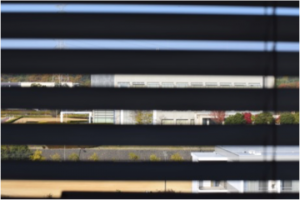

実は通常のカメラを用いた場合でも,条件によっては,ただ撮影するだけでシーン中の不要物体を除去することができます.その条件というのは,例えば,開口の大きなレンズを用いて,消したい不要物体が手前にある場合などです.レンズの開口が大きいほどフォーカスが合う位置が狭くなるのですが,そのことをうまく利用すると,不要物体(ブラインド)を大きく「ピンぼけ」させることができ,あたかもブラインドが無くなってしまったかのようなシーンを撮影することが可能となります(図1).

図1:「ピンぼけ」によるブラインド除去.中:レンズ開口を小さくした場合と,下:レンズ開口を大きくした場合の撮影画像

図1:「ピンぼけ」によるブラインド除去.中:レンズ開口を小さくした場合と,下:レンズ開口を大きくした場合の撮影画像

しかしながら,先ほど述べたような制約が必要になるため,一般的な不要物体の除去を行うことはできません.

そこで,このような現象に着想を得て,光線空間の情報から,1画素ごとにフォーカス位置を決めるようにできるアルゴリズムを開発しました.1画素ごとにフォーカス位置を決めることができるため,図2に示すように,注目する物体にはフォーカスを合わせてくっきりと,柵などの不要な物体は,大きくピンぼけさせて消してしまうことが可能となります.

図2 通常撮影(上)と,柵だけを「ピンぼけ」させた画像(下)

図2 通常撮影(上)と,柵だけを「ピンぼけ」させた画像(下)

なおこの成果は,電気関係学会関西連合大会で発表を行い,映像情報メディア学会関西支部優秀論文発表賞を受賞しました.

光線の取捨選択・リフォーカス

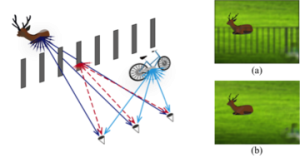

図3のように,動物から来た光線だけを選択し,写したくない柵から来た光線だけを選択し,捨ててしまうことで,不要な柵を除去した画像を生成することができます.

図3 (a):観測したすべての光線を用いて画像化, (b):柵からの光線(左図赤色の光線)を除去して画像化

図3 (a):観測したすべての光線を用いて画像化, (b):柵からの光線(左図赤色の光線)を除去して画像化

さらに,光線空間を用いることでLytro(https://www.lytro.com)のように,ユーザが好きな位置にフォーカスを合わせ直すことが可能となります.

デモンストレーションのために作成したソフトウエアを図4に示します.ソフトウエアの左側に表示されている画像が通常のリフォーカス,右側に表示されている画像が,柵からの光線を除去したリフォーカス画像です.下のスライダを移動させることによって,任意の位置にフォーカスを合わせることができるようになります.

図4 スライダ調整で後ろの物体にフォーカスを合わせた場合(上)と,同様に前の物体にフォーカスを合わせた場合(下)

図4 スライダ調整で後ろの物体にフォーカスを合わせた場合(上)と,同様に前の物体にフォーカスを合わせた場合(下)

オープンキャンパスでのデモンストレーション

2015年3月7日に行われたオープンキャンパスにて,これらの成果をデモ実演いたしました.図5は,「写ラナインです」のデモセットの写真です.

手前が光線空間を取得するための装置で,その奥に見えるのが,撮影シーンに見立てたジオラマです.デモ時には,ジオラマ上の緑の網の除去を行いました.

デモ時には,たくさんの方に足を運んでいただき,光線空間の取得によるイメージングについて知っていただくことができました.また,様々な方から驚きの声を頂戴できたのが印象的でした.さらに,本プロジェクトは,オープンキャンパス参加者からの最多得票により本年度CICPの最優秀プロジェクトに選ばれました.

今後も「光」をテーマとして,驚きと楽しさを感じていただけるような研究を進めていきたいと思います.

(M1 三原)

おわりに

2015年3月に舩冨准教授が着任し,2015年度の新入生受け入れに向けて,着々と準備を進めています.4月には新たなメンバを受け入れ,ようやく2学年が揃った研究室になります.これから,光メディアインタフェース研究室が本格始動します.今後の活動に,どうぞご期待ください!